AI 设计模式完全指南

AI 设计模式完全指南

用最简单的语言,讲清楚 AI 领域最核心的设计模式。每个模式都回答三个问题:是什么?什么时候用?怎么理解?

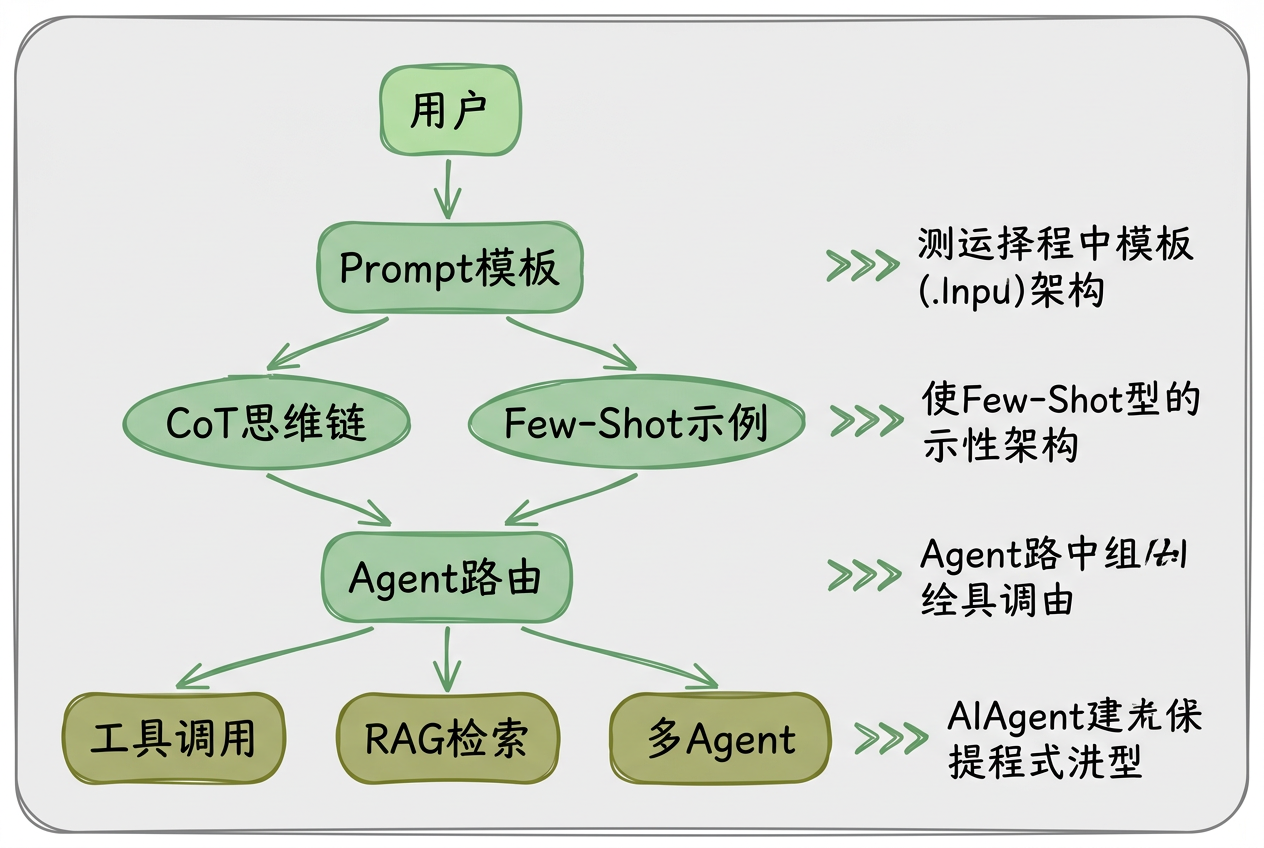

一、Prompt 设计模式

1. Chain of Thought (CoT)

是什么: 让 LLM “一步一步思考”,而不是直接给答案。通过在 prompt 中引导模型展示推理过程,提升复杂任务的准确性。

什么时候用: 数学推理、逻辑分析、多步决策等需要推理链的场景。

2. Few-Shot Prompting

是什么: 在 prompt 中提供几个示例(输入→输出对),让模型通过类比学习来处理新任务。

什么时候用: 格式化输出、分类任务、风格迁移等需要明确输出模式的场景。

3. Prompt Chaining

是什么: 将一个复杂任务拆分成多个子 prompt,前一个的输出作为后一个的输入,形成流水线。

什么时候用: 复杂文档处理、多阶段生成、需要中间校验的工作流。

二、Agent 设计模式

4. ReAct (Reasoning + Acting)

是什么: 让 Agent 交替进行”推理”和”行动”。先思考下一步该做什么,再执行动作,观察结果后继续推理。

什么时候用: 需要与外部环境交互的复杂任务,如搜索、数据查询、多步骤问题解决。

5. Tool Use

是什么: 赋予 LLM 调用外部工具(API、计算器、数据库等)的能力,扩展其能力边界。

什么时候用: LLM 自身能力不足的场景——实时数据获取、精确计算、代码执行等。

6. Router Pattern

是什么: 用一个”路由器”模块分析用户意图,将请求分发给最合适的专用模型或处理链路。

什么时候用: 多功能系统、需要根据输入类型选择不同处理策略的场景。

7. Multi-Agent

是什么: 多个 AI Agent 协同工作,每个 Agent 有不同的角色和专长,通过消息传递协作完成任务。

什么时候用: 复杂项目(如软件开发、研究报告撰写)、需要多角度审视的任务。

三、LLM 应用架构模式

8. RAG (Retrieval-Augmented Generation)

是什么: 先从知识库中检索相关文档,再将检索结果作为上下文输入给 LLM 生成回答。

什么时候用: 企业知识问答、基于私有数据的对话、需要减少幻觉的场景。

9. MCP (Model Context Protocol)

是什么: 标准化协议,让 AI 应用以统一方式连接各种数据源和工具,类似 AI 世界的”USB 接口”。

什么时候用: 需要 AI 连接多个外部系统、构建可插拔工具生态的场景。

10. Agentic RAG

是什么: 在 RAG 基础上加入 Agent 能力,让系统能自主决定何时检索、检索什么、是否需要多轮检索。

什么时候用: 复杂知识问答、需要跨多个知识源综合推理的场景。

四、AI 交互设计模式

11. Human-in-the-Loop

是什么: 在 AI 自动化流程中设置人工审核/确认节点,确保关键决策有人把关。

什么时候用: 高风险决策、内容发布、代码部署等需要人工确认的环节。

12. Guardrails

是什么: 为 AI 系统设置输入输出的安全边界和规则约束,防止产生有害或不符合预期的内容。

什么时候用: 面向用户的 AI 产品、需要合规控制的企业应用。